試圖與機器協商的人

唷,大家安安。

回想起來,好像從沒跟大家分享過我發想作品的過程(其實也沒很想這麼做,又害羞又覺得不值得拿出來講)。但趁著這次《Genesis》發表,稍微有一些值得跟大家分享的事情。畢竟一個不懂編程,也不數位的藝術家,居然做了這樣的作品,太奇怪了。

***

最開始 黃豆泥 介紹我Pixray的時候,我先後算了幾張圖,也看了一些別人的成品。或許是運氣好吧,有跑出幾張還算不錯看的圖片,當然也發現裡面好玩的地方。其中最吸引我的地方是,機器的「誤讀」與「偏差」所生成的造型與效果。所謂的誤讀並非是機器出現錯誤,舉例來說:當我輸入蘋果的時候,他跑出一台哀鳳,你要說是蘋果也沒錯吧。而偏差則是,在我輸入某些字串時(如香蕉),我原本預期他只給我一串或一根香蕉,結果整個畫面都香蕉化了。

這樣的事情是有趣的,彷彿AI總是能給出各種超乎我想像的答案。在這個階段,圖像的創造性仍由它所掌握(我也僅將它作為靈感工具)。而我就像遇到一個奇怪的外星人,不斷丟出問題,想聽聽它那超乎我經驗、無厘頭的回應。

第一階段的試驗,我試著用維拉斯奎茲的《仕女圖》作為關鍵字,搭配其他字句與其互動。首先遇到的問題便是,如何讓它精確明白我所指的《仕女圖》是什麼。我嘗試過加入畫家的名字,或乾脆將「維拉斯奎茲的仕女圖」作為字串使用,要嘛就是不知道偏到什麼地方去,要嘛乾脆跑出維拉斯奎茲其他的畫作黏在一起。有趣的是,單看其中一張圖像時,還難以聯想到《仕女圖》,但把一堆成果擺在一起時,線索則便得清晰。

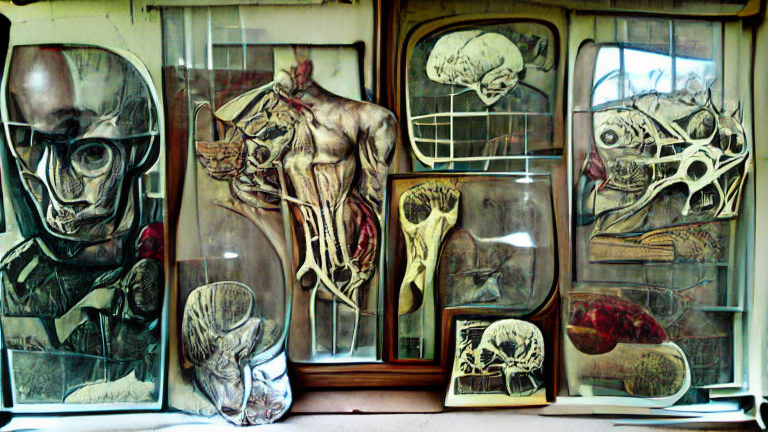

另一方面,我也注意到某些字串的效果會渲染到畫面其他造型上,成為造型的「表面肌理」。舉例來說,我輸入「肌肉解剖圖」,裙子變成粉嫩的肉塊。(圖一)。字串效果成為造型的「表面肌理」給了我很大的鼓勵。在這種狀況下,生成的圖片往往具有更強烈、更意想不到的個性(尤其是無法完全掌控這些肌理會出現在什麼地方)。也因此,我試圖嘗試更多不同的關鍵字,來測試對畫面的影響。但不管哪個,我通常會將同樣一組字串,算個至少20張,來理解它表達的範疇可能為何。

第二階段,更聚焦的測試其他東西,以確定我該如何引導外星人,好好回應我的問題,建立溝通的可能。測試的項目包含:讓畫面表達簡潔一點、製造空間感、拼貼影像的技巧、浮世繪與動漫的拼接。

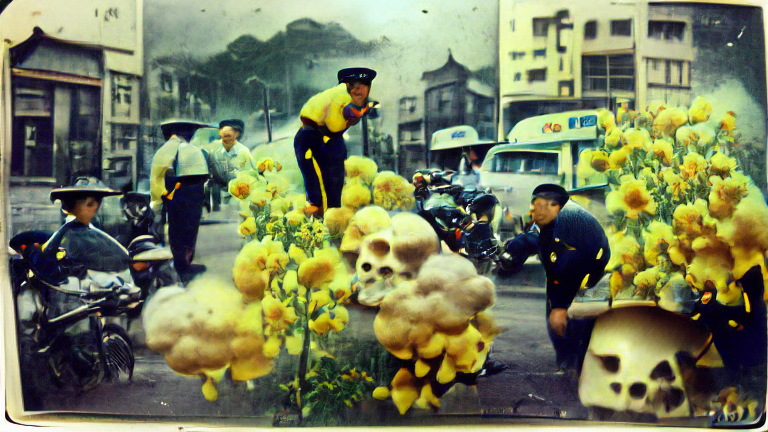

想讓畫面變簡潔,從之前的經驗知道,減少字串無法讓畫面變得簡潔。因此我採取的辦法是,使用例如窗景、櫃子、地毯之類等字串。我預期在格子以外的地方,會有框線、物件本身的材質對畫面進行切割。而製造空間感,則試過使用魚眼鏡頭、透視法、空房間之類的字串。效果並不穩定,尤其魚眼鏡頭常伴隨著大量的雜物一起出現。但運氣夠好的話,總有幾張效果不錯。最終發現,更實際的做法會是挑選本身就具有透視效果的字串使用(如:城市街景、窗景、隧道),儘管不見得百發百中,但已經算相對穩定了。(圖二、三)

與豆泥在德叡的夾娃娃前針對這個發現做了一番討論,亦即:當我們描述一個關鍵字時,機器擷取的影像便是人類集體對該字詞所生產出來的影像、圖像之集合。這代表,機器對同樣字串的理解,是受限制的(如豆泥文中對艾菲爾鐵塔一例的描述)。有趣的地方也在於,這些理解往往不如我們預期的表現在畫面中(想想香蕉的故事)。

豆泥文章在此:https://reurl.cc/82EN1M

拼貼影像的部分,則是以台灣復古街景照片作為關鍵字,效果其實不差。因此我更細緻往下思考,有沒有什麼樣的對象可能以影像的方式作為圖源存在,因此我試驗了「台灣警察暴力」以及特定地標。說實話,雖然有幾張不錯的成品,但感覺大同小異,我猜測或許是我使用的關鍵字能擷取到的資料實在不多。(圖四)

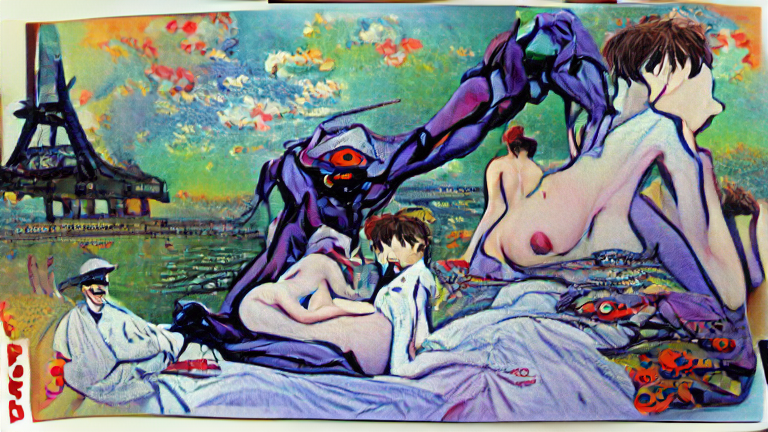

想到在脈絡上,浮世繪與日本動漫應該算是有些關聯,便試著把它們拚在一起看看。可惜浮世繪作為字串使用時,太過強烈,常常整張圖都被它吃掉。過程中意外發現,當我將福音戰士初號機、太陽之塔作為字串時,反而沒有出現我所期待的造型,更多是他們的色彩、配色,影響了整個圖像的構成。(圖五)

簡單總結一下,要能完成一幅完整度相對高的圖像,不外乎:構圖、造型、色彩、肌理。而第一階段的測試,我發現解決「肌理」可能的辦法。第二階段則是「構圖」與「色彩」。造型倒是相對好解決的事情(只是偶爾要換個思路:例如想要畫一個太陽,說不要要改用「橘色的球體」或是「銀色的海膽」。)最大的困難或許是,如何讓你輸入的字串以你期待的方式出現(到底是色彩、造型或是肌理)。

一直到這邊,我意識到人是有可能與機器進行協商。在不透過編程或提示文字去影響機器的狀況下,除了能保留機器誤讀、偏差所帶來的圖像創造性,並且讓我所期待的畫面元素佈署在其中。更甚至,能在構圖、色彩、造型、肌理上,盡可能滿足我的期待。

第三階段,則開始嘗試與機械協商(也就是之前送給豆泥跟德瑞的封面圖)。這比我想像德還要困難,也還要耗費力氣(溝通成本真的很高呀,朋友)。以送給豆泥的那張圖為例(圖六)。我想要表現醫科背景、章魚干、黃色的豆子,且讓畫面主題可以清晰。來來回回算了可能也有三百多張圖。其中我覺得傑出的一手,便是使用「小小兵」字串,黃色的又是豆子狀,多棒啊。但還是試了很多次,甚至透過GOOGLE圖片輔助,摸索怎樣增加條件會更具體(常常畫面散落許多小小兵,或者混進不相關的東西)。最後以小小兵為字串的部分,記得是「minion profile portrait」才較為精準鎖定。其他使用的關鍵字有點記不清楚,但大概有手術室、章魚、金屬櫃(統整畫面的好幫手,金屬可換成其他材質,推薦大家試試看)之類的。(圖六)

***

經過漫長的第三階段,我更確信人跟機械的協商是有機會的。也從這裡開始,我開始構思透過「與機器協商」這件事情取回一部分的創造性,如何發展成一個創作計畫。

然後就是《Genesis》了。

對我來說,米開朗基羅的《創世紀》無疑是個好的切入點。除了連結到生成技術之外,也連結到創造的寓言,更重要的是作為文藝復興時期的畫作,能連結到人本精神。這個創作計畫中,比起如何生成出好看的圖片,更重要的絕對是背後我想討論的事情,以及對人與機器關係的的思考。

生成出好看的畫面真的不難,暴力一點的解法,骰子骰多了總會出現好結果(猴子都有機會隨機敲出莎士比亞全部作品)。若你能好好解決構圖、造型、色彩、肌理,大概率出來都不會太難看。但要當作「作品」來看,我還是期待在看似輕盈的視覺內容之外,有其他能談論、思考的內容。尤其是在不懂編程的狀況下,我能另闢膝蓋,做自己能力範圍內可能做到的事情。

說實話,一直到《Genesis》完成之後,我還是看不懂那些技術細節。當然大致上原理還算知道,但爬文的時間都拿來算圖跟做測試,也沒打算透過指令去影響機器(一方面無此創作需求,一方面直覺會影響此創作計畫的純度)。

最後偷偷分享一下,平均一張《Genesis》大概要算個400~450張圖才有30張左右可能可以用的:元素到位、構圖不錯、色彩協調、與其他張圖的風格不至於太過斷裂。這種「農」的感覺,不亞於暗黑破壞神呀……只是它們骰裝備,我則是骰圖片。